Die Programmiersprache des Gehirns

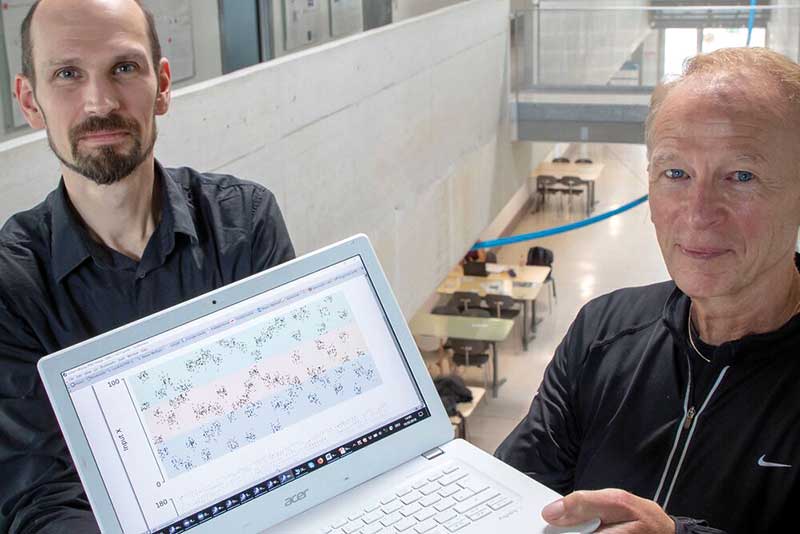

Tobias Ludwig

(01.09.2020) GRAZ: Forscher modellieren komplexe Denkprozesse im Gehirn und versuchen so nicht nur kognitiven Fähigkeiten auf die Spur zu kommen, sondern auch Rechenparadigmen für eine neue Generation von Computern zu entwickeln.

Der Gedankenblitz gilt als Sinnbild für einen plötzlichen Einfall. Das Bild des Blitzes kommt dabei erstaunlich nah an das heran, was permanent in unseren Gehirnen abläuft: Neuronen, die bekannten „grauen Zellen“, feuern elektrische Impulse (Aktionspotenziale) ab. Damit aktivieren oder hemmen sie weitere Neurone, die über Synapsen miteinander verbunden sind. Wie aus einem so vermeintlich einfachen Mechanismus hochkomplexe Werke wie die Sinfonien eines Johann Sebastian Bach oder die Aufsätze eines Immanuel Kant entstehen, ist auch heute noch nicht völlig verstanden.

Die effiziente Art der Datenverarbeitung im Gehirn zieht dabei nicht nur Neurobiologen in ihren Bann, sondern auch Informatiker wie Robert Legenstein. Der Leiter des Instituts für Grundlagen der Informationsverarbeitung an der Technischen Universität Graz erzählt: „Das Interesse der Informatik an den Prozessen im Gehirn liegt in der Frage begründet, wie man bessere, effizientere Computer bauen kann.“ Zwar sind die heutigen Rechenknechte in der Lage, Abermilliarden komplexer Berechnungen in atemberaubender Geschwindigkeit durchzuführen, scheitern aber beispielsweise als Schaltzentrale eines Roboters an vermeintlich einfachen Aufgaben wie Laufen, ohne umzufallen. Ein Grund sind prinzipielle Limitierungen, die aus der heute üblichen Bauweise von Computern resultieren. Legenstein: „Unsere PCs sind alle nach der Von-Neumann-Architektur gebaut. Das heißt: Die Prozessoreinheit, also der Teil, der die Berechnungen durchführt, ist vom Speicher, wo Ergebnisse und Variablen gespeichert werden, getrennt.“ Daher müssten permanent Daten vom Speicher in den Prozessor geladen werden, was zu erheblichen Effizienzeinbußen führt – der sogenannte Von-Neumann’sche Flaschenhals.

Auf den Spuren der Assemblies

Die menschliche Schaltzentrale agiert da effizienter. „In unseren Gehirnen sind Rechen- und Speichereinheit verbunden“, erläutert der Grazer Informatiker. „Wir finden hier Milliarden von Rechenelementen, nämlich unsere Neurone, die gleichzeitig über eine Art Speicher, die Synapse, verfügen.“

Diese Erkenntnis allein reicht jedoch nicht aus, um damit eine neue Computer-Generation zu entwickeln. Dafür orientieren sich die Forschenden um Legenstein und seinen Grazer Kollegen Wolfgang Maass an einem bereits 1949 von dem Psychologen Donald Olding Hebb postulierten Konzept: den neuronalen Assemblies. Nach Hebb könnten höhere kognitive Fähigkeiten, wie die Verarbeitung von Sprache, nur mittels Zusammenschlüssen mehrerer Neurone realisiert werden. Dabei codieren die Assemblies jeweils für ein Konzept.

„Wenn Sie an eine bestimmte Person denken, dann sind die Informationen über diese Person wahrscheinlich nicht in einer einzigen Gehirnzelle, sondern in einem ganzen Zellverbund gespeichert“, erklärt Legenstein. Dabei sei es wahrscheinlich, dass sich Neurone aus mehreren Hirnarealen zu Assemblies zusammenschließen, da unterschiedliche Aspekte einer Person, wie beispielsweise ihr Name, Aussehen und die Gefühle des Denkenden gegenüber dieser Person, in verschiedenen Regionen des Gehirns verarbeitet werden.

Über Dekaden blieb diese Hypothese reine Spekulation und erst durch neuere Studien mehren sich die Hinweise für die Existenz dieser Assemblies. Legenstein: „Es war in der Vergangenheit schwierig, das elektrische Potenzial von vielen Neuronen im Gehirn zu messen. In Menschen sind solche Versuche möglich, wenn ihnen aus medizinischen Gründen Elektroden in das Gehirn eingesetzt werden.“ Ein internationales Forscherteam um Rodrigo Quian Quiroga von der University of Leicester in England hatte im Jahr 2005 Probanden unter anderem Bilder von berühmten Personen gezeigt und versucht, deren Reaktion in Form von neuronalen Aktionspotenzialen zu messen (Nature 435: 1102-7). „Hier wird die Interpretation nun etwas schwierig“, räumt Legenstein ein. „Da die Messung der Aktionspotenziale möglich war, hat man geschlossen, dass es sich hierbei um das synchrone Feuern zahlreicher Neurone handeln müsse, da es wegen der enormen Anzahl von Neuronen im Gehirn sehr unwahrscheinlich ist, genau das eine Neuron zu finden, das auf diese Person anspricht.“

Ein Gehirn in der Nussschale

Weitere Hinweise kommen auch aus Tierstudien. Zwar bringe es nichts, Mäusen Bilder von Berühmtheiten zu zeigen, wie Legenstein lachend einwirft, dafür sei hier die genaue Identifizierung aktiver Neurone mittels Optogenetik möglich. „Dadurch konnte man zeigen, dass vor allem im Hippocampus der Mäuse bestimmte Konzepte wie eine angstauslösende Erinnerung durch Gruppen von Neuronen codiert werden.“

Um zu verstehen, wie es zur Bildung solcher Assemblies kommt, simulierten die Grazer nun deren Entstehung am Computer. Dafür modellierten sie stark vereinfachte Neuronen, die nach dem Zufallsprinzip mit anderen Neuronen in einem definierten Gitter über Synapsen verbunden waren. Einige Eigenschaften der Zellen definierten die Forscher um Legenstein und Maass vorab. „Wir mussten vor allem die Plastizität simulieren. Das heißt, Verbindungen werden durch wiederholte Nutzung gefestigt. So funktioniert auch unser Gedächtnis“, so Legenstein. Je öfter und stärker ein Neuron angeregt wurde, desto „fester“ wurden seine bestehenden Verbindungen zu den anderen Nervenzellen. Zudem rechneten die Grazer die unterschiedliche Reaktionsstärke der grauen Zellen mit ein, denn nicht jedes Neuron reagiert gleich stark auf einen Reiz. Ihr Modell veröffentlichten sie im März dieses Jahres in Cerebral Cortex (30: 952-68).

Maschinencode des Denkens

Unter diesen Bedingungen schlossen sich unter dem Einfluss eines simulierten „äußeren“ Reizes stets Gruppen von Neuronen zusammen, die diesen gemeinsam verarbeiteten. Dabei entstanden die Assemblies „on-the-fly“, das heißt dynamisch und ohne vorher für die Verarbeitung dieses Reizes definiert worden zu sein. Um die Güte ihrer Simulation zu testen, überprüften die Wissenschaftler die Vorhersagen ihres Modells für bestimmte neurobiologische Beobachtungen.

Es war erneut Quian Quiroga, der mit einer Forschergruppe aus Großbritannien und Israel bereits experimentell nachgewiesen hatte, dass sich Konzepte im Gehirn verbinden können. Die Wissenschaftler zeigten Probanden jeweils Bilder von Familienangehörigen und dem Eiffelturm. Auf die Fotografien ihrer Liebsten reagierten bestimmte Neurone im Hippocampus stark, nicht aber auf Bilder des Eiffelturms.

Zeigten die Forscher den Probanden jedoch zunächst ein Bild, auf dem ihre Familienangehörigen mit dem Eiffelturm abgebildet waren, so feuerten danach auch dieselben Neurone, wenn sie nur das Pariser Wahrzeichen sahen. Diese Assoziation neuronaler Assemblies konnten die Arbeitsgruppen von Legenstein und Maass in ihrem Modell reproduzieren. „So entsteht ein Netzwerk von Assemblies, die Beziehungen zueinander haben und auch teilweise überlappen. Daraus resultiert eine riesige Datenstruktur um diese Konzepte und ihre Beziehungen zueinander“, fasst Legenstein zusammen.

Die Frage war nun, wie aus diesem dynamischen Neuronen-Netzwerk höhere kognitive Fähigkeiten entstehen. Dafür entwickelten die Grazer zusammen mit Forschern der Columbia University in New York Operationen, die wie eine Programmiersprache auf den Assemblies ausgeführt werden konnten (PNAS 117 (25): 14464-72; eNeuro 7: 1-17). Diese Operationen bildeten neurobiologische Prozesse, wie die bereits erwähnte Assoziation von Assemblies, ab. Für komplexere Aufgaben machten sich die Forscher Erkenntnisse aus der Linguistik zunutze. Legenstein: „Um Sprache zu verstehen, brechen wir Sätze in bestimmte Komponenten auf. Bei dem Satz: ‚Das Kind hat den Ball getreten‘ identifizieren wir einen Akteur, das Kind, und ein passives Objekt, den Ball.“ Die Beziehung zwischen den einzelnen Komponenten müsse nun im Gehirn hergestellt und geordnet werden. So gebe es bestimmte Hirnareale, in denen die Akteure in Assemblies codiert seien, und andere, die den passiven Objekten vorbehalten seien. Hören wir diese Komponenten in einem Satz, werde zwischen den jeweiligen Assemblies eine Verbindung hergestellt und eine neue Assembly kreiert, die den gesamten Satz enthält. „Unser Gehirn verfügt also über eine Art Assembly-Lexikon“, so Legenstein und ergänzt: „Wir nehmen an, dass man dadurch komplexe Sätze und andere komplizierte Zusammenhänge semantisch strukturieren kann. Das menschliche Sprachverständnis könnte so funktionieren.“

Was die Gruppen um Legenstein und Maass bisher entwickelt haben, seien die ersten Schritte in Richtung neuer Algorithmen für die Verarbeitung komplexer Daten. „Wir arbeiten gerade mit Kooperationspartnern daran, unsere Modelle auf Chips zu implementieren, um damit bestimmte Operationen ausführen zu können“, erläutert der Informatiker die Pläne für die Zukunft. Eine denkbare Anwendung für diesen Assembly-basierten Ansatz sei die Verbesserung von Spracherkennung und -ausgabe, wie wir sie bereits von digitalen Assistenten wie Siri, Google Assistant oder Alexa kennen. Ferner wollen die Grazer mehr Wissen aus den Neurowissenschaften integrieren, um näher an die beeindruckende Effizienz des menschlichen Vorbilds heranzureichen. Auch das Verständnis menschlicher Kognitionsprozesse wolle man erweitern. Zu konkreten Projekten wollte sich Legenstein allerdings noch nicht äußern.

Letzte Änderungen: 01.09.2020